美光内存与存储是实现数字孪生的理想之选

据 IDC 预测,从 2021 年到 2027 年,作为数字孪生的新型物理资产和流程建模的数量将从 5% 增加到 60%。尽管将资产行为中的关键要素数字化并非一种全新概念,但数字孪生技术从精确传感到实时计算,再到将海量数据转为深度洞察,从多方面进一步推动了设备和运营系统优化,从而实现扩大规模并缩短产品上市时间。此外,启用人工智能/机器学习 (AI/ML) 模型将有助于提高流程效率、减少产品缺陷,实现出色的整体设备效率 (OEE)。

当我们了解了上述需求的复杂性和面临的挑战,就能意识到内存与存储对于实现数字孪生至关重要。

首要挑战 — 如何提取恰当的数据

创建数字孪生不仅是对物理特性的单向感知,还包括对内外子系统交互进行建模。例如,感知发电机振动的谐波轮廓有助于人们深入理解孪生图像如何与电机、轴承、皮带的物理特性相关联,及其相互作用产生的影响。如果人们想为一台机器创建“数字孪生”,仅通过在它周围安装传感器,而忽视其子系统之间的相互依存,将无法得到真正意义上的“孪生”。

为现有系统创建数字孪生则更加复杂,因为在已运行的机器上添加新传感器并非易事。实际上,概念验证的第一步是添加一个拥有极少接口的 DIY 或嵌入式电路板,以支持从传感器到云的数据转换。添加连接部分相对简单,而实际建模却非常复杂,需要存储动态数据并将其与训练好的模型进行对比。不仅如此,由于有数十甚至数百种系统需要建模,该方法并不是最具可扩展性的解决方案。

计算将持续演进

内置于卷积神经网络 (CNN) 加速器的新处理器架构是实现更快推理计算的良好开端。这些设备不仅可以接收模拟信号,还能在设备内部处理和过滤数据噪声,仅保留与模型相关的值。这些特性为智能端点量身定制,其并行操作性能可达 GFLOPS(每秒十亿浮点运算)量级,略低于 20 TOPS(每秒万亿次运算)。

低成本、低功耗的 GPU 也十分重要。它们提供了基于硬件的机器学习计算引擎,运行更敏捷,计算性能更强大,可实现更高的 OPS(每秒操作次数)。业界目前已有专为边缘设备设计的 GPU,其操作次数低于 100 TOPS,以及更多基础设施级别的 GPU,操作次数高于 200+ TOPS。

低功耗 DRAM 内存是 AI 加速解决方案的理想之选

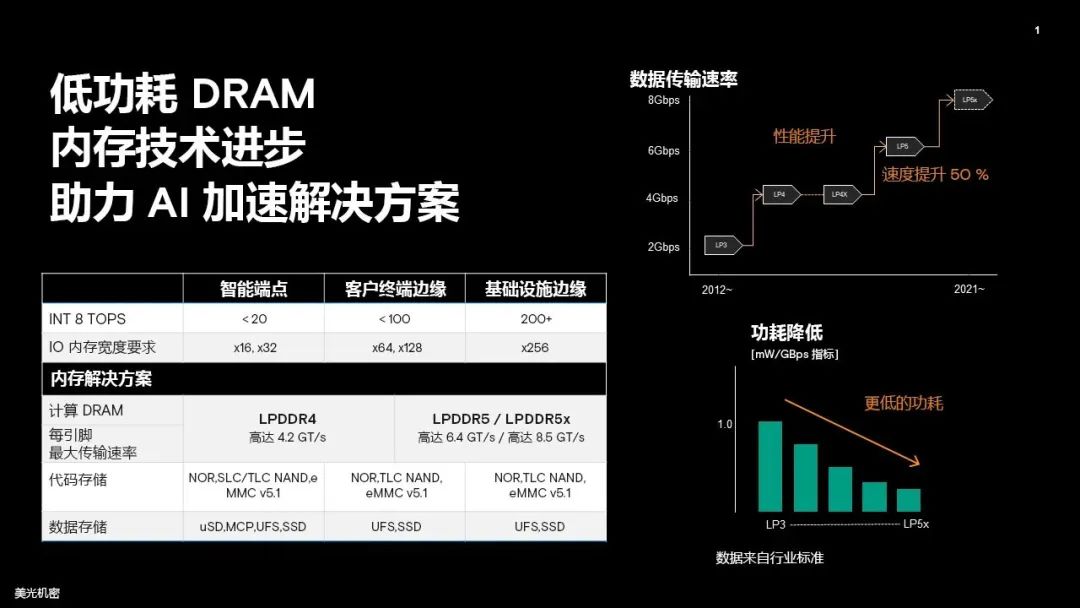

显而易见,由于架构不同,配备加速器的多核通用 CPU 可能需要 x16 或 x32 位内存宽度,而高端 GPU 则可能需要高达 x256 位内存宽度的 IO。

如果在计算时将 GB 级数据移入或导出至外部内存,就需要内存拥有更高的总线带宽性能。下表显示了对内存接口的性能要求(基于 INT 8 TOPS 要求)。

伴随不断推出的新标准,内存性能也在持续提升以满足 AI 加速解决方案的要求。例如,LPDDR4/x(低功耗 DDR4 DRAM)和 LPDDR5/x(低功耗 DDR5 DRAM)解决方案的性能较前代技术相比有了显著提升。

LPDDR4 的传输速率高达 4.2 Gbps 且支持 x64 的总线带宽。LPDDR5x 的性能与 LPDDR4 相比提高了 50%,且传输速率翻倍,可达 8.5 Gbps。此外,LPDDR5 的能效相比 LPDDR4X 也提高了 20%。这些显著进步有助于提升内存整体性能,以匹配前沿的处理器技术。

嵌入式存储可支持复杂的机器学习

计算资源不仅受到处理单元原始 TOPs 和内存架构带宽的限制。随着机器学习模型越来越复杂,模型参数数量正以指数级速度增长2。

为了提高模型效率,机器学习模型和数据集不断扩张,因此需要更高性能的嵌入式存储。典型的托管型 NAND 解决方案(例如 3.2Gb/s 的 eMMC 5.1)不仅是代码读取的理想之选,也适用于远程数据存储。新兴技术(如 UFS 接口)的出现使存储性能提升了 7 倍 ,可实现 23.2 Gb/s 的传输速率,能够支持更复杂的模型。

这些嵌入式存储技术也是机器学习资源链的组成部分。

选择合适内存,助力数字孪生

众所周知,边缘端点和设备将产生 TB 级数据,这不仅因为数据本身具有保真度,还因为接入数据能帮助改进数字模型——这正是实现数字孪生所需要的。

此外,应用代码也需扩展以管理数据流和边缘计算平台基础设施,同时增加 XaaS(即服务)业务模型。

数字孪生技术拥有广阔的发展前景,但如果只针对“鼻子”或“眼睛”等局部构建“孪生”,就缺乏完整的“面部图像”,也就很难确定这是否是真正意义上的“孪生”。因此,未来在谈及数字孪生时需要考虑多重因素,包括监测对象与所需的计算内存和数据存储。美光作为工业内存解决方案领域的前沿厂商,提供了广泛的嵌入式内存产品,包括基于 1-alpha 技术以用于快速 AI 计算的 LPDDR4/x 和 LPDDR5/x 、集成在 eMMC 中的 176 层 NAND 技术,以及支持 UFS 的存储解决方案。这些重要的内存与存储技术将助力美光满足您的计算需求。

1 IDC FutureScape,2021 年

2 “机器学习中的参数个数”(Toward Data Science),2021 年

作者:Wil Florentino——Wil Florentino 担任美光工业市场业务部门高级市场营销经理,负责提供与市场相关的洞察与专业见解,例如工业物联网(IIoT)和工业边缘计算,以支持新产品路线图中的内存解决方案。Florentino 先生在嵌入式半导体技术领域(SoC、FPGA、微控制器和内存)拥有超过 20 年的工作经验,主攻工业应用。

加入微信

获取电子行业最新资讯

搜索微信公众号:EEPW

或用微信扫描左侧二维码

相关文章

-

2024-06-04

-

2024-06-04

-

-

-

-

2024-05-16

-

-