AI革命临近AIPC市场爆发推动芯片产业飞跃

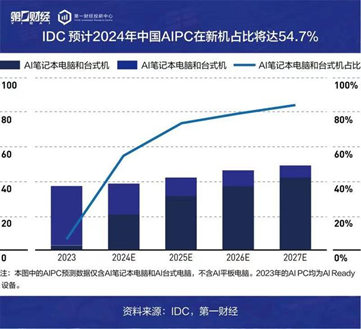

如今AIPC快速崛起,有机构预测,2024年是AIPC的元年,2024年的出货量有望突破5000万台,2025年出货量将突破1亿台。未来,它将成为市面上的主流电脑,可是提到AIPC,很多人对这个概念并不太熟悉,其实顾名思义,AIPC就是AI电脑,是一种集成了人工智能技术的个人电脑。

它通过在处理器中集成NPU,配合CPU、GPU等硬件,通过人工智能技术加持,从而释放人们的生产力和创作力,提升我们的工作效率,AIPC可以应用于各种场景,包括图形视觉、语义理解、智能交互等。 除此之外,它区别于普通的PC,AIPC将为用户提供包括通用场景下的个性化服务,具有即时、可靠的服务响应,更低的大模型使用成本,可信、安全的个人数据和隐私保障等四大价值。

相比传统PC,硬件方面,AIPC在传统PC职能的基础上,集成了混合AI算力单元,以支持复杂的人工智能算法和大量的数据处理。AIPC通常配备了高性能的处理器,能够支持包括CPU、GPU、NPU在内的异构计算,整体算力支撑能力更强,能够本地运行“个人大模型”、创建个性化的本地知识库,实现自然语言人机交互。

它不仅内置为用户提供这两年大火的ChatGPT类似的通用大模型,可以非常方便地让用户通过LLM(自然语言大模型)进行新的交互并有效地提高日常办公的效率和质量,同时也可能在PC上部署安装类似于Stable Diffusion专业大模型进行本地化AI创作,这将彻底改变PC用户的使用习惯和场景,也改变了PC产业的发展未来,PC由个人计算终端升级成了个人AI应用中心。

AIPC并非一个具体的产品名称,而是一个概念性的术语,用于描述那些专门用于人工智能计算的个人电脑。具体的AIPC产品可能会因厂商和配置而有所不同。各处理器制造商纷纷进军 AI 芯片。IDC 认为一台“具备 AI 能力”的 PC 必须拥有专用的芯片组或模块来 加速 AI 计算。目前高通的 Hexagon 加速器、苹果的神经引擎、英特尔的 Movidius VPU 和 AMD 的 APU 可 以满足以上要求。

与此同时,芯片厂商英特尔、英伟达、AMD、高通都加入了AIPC芯片市场的军备竞赛。

英特尔最先提出了AIPC这个概念。2023年9月英特尔发布了第十四代处理器Meteor Lake,同时公布了集成了神经网络处理单元(NPU)处理器酷睿Ultra将于年底上市,这是英特尔历史上第一款集成了NPC单元的SoC。

英特尔酷睿 Ultra 处理器的诞生,标志着 PC 全面进入 AI 时代。英特尔通过发布最新一代酷睿Ultra系列AI处理器,成功地将AI硬件核心——AI处理器嵌入到pc的心脏部位。该系列涵盖了三种不同的配置版本:酷睿Ultra 5、酷睿Ultra 7以及顶级的酷睿Ultra 9。

英特尔酷睿Ultra AI处理器采用Intel 4先进制程工艺打造,通过Foveros 3D封装技术,性能和能效都显著提升,并首次使用了分离式的模块化架构设计 ,在提高续航的同时离电性能更好。全新架构提升了每时钟周期指令执行能力,并通过性能核(P-cores)、能效核(E-cores)及低功耗能效核(LP E-cores)的协同工作,极大地优化了多任务处理性能。

5 月 11 日,英特尔人工智能创新应用大赛总决赛暨颁奖典礼在北京举办,在本次大赛中,针对不同的应用开发场景,参赛者在搭载英特尔酷睿 Ultra 处理器的 AIPC 上灵活利用 CPU、GPU 和 NPU 三大 AI 引擎,以及 OpenVINO、IPEX-LLM 等丰富的开源软件框架及优化工具链,快速进行 AI 调优及部署,开发可落地的创新应用。

英特尔业务总监透露,随着芯片算力的不断进步,未来几年内将有显著的增长。他预计,明年芯片算力的提升将是大踏步的,到2028年时,约80%的PC出货量将是AI个人电脑(AIPC)。

英特尔AI平台在微软Phi-3 AI模型发布当天即实现优化支持

英特尔人工智能创新应用大赛落幕,英特尔通过OPEA助力企业加速AI创新

创意无限!英特尔人工智能创新应用大赛激发AI PC体验的更多可能

已有超过500款AI模型在英特尔酷睿Ultra处理器上得以优化运行

英特尔至强和AI PC等产品为Meta Llama 3生成式AI工作负载提供加速

几乎在同时,X86处理器阵营的英特尔和ARM阵营的高通推出了集成NPU单元的桌面处理器,AMD和微软的活动展示了AI在PC领域的应用加速,预示着AIPC的市场潜力。预计2024年AIPC的渗透率将显著提升,带动PC出货量增长和产业链相关公司的机会。

在去年更早一些时候,X86阵营的另外一家主力处理器厂家AMD就宣布,在其最新Zen4架构的7000系列处理器中,加入了AI引擎,全面支持AI应用程序加速。Zen架构处理器其中集成了RDNA3架构集显、XDNA架构的AI计算单元,在AI性能与游戏性能上均有不同幅度的提升,其中AI算力高达业界领先的39TOPS。

从以往的历史来看,AMD可以说是对AI PC特别有话语权的一家厂牌,因为早在很多年前的APU时代,他们其实就已经尝试过一些基于异构融合算力的通用计算、甚至机器学习功能。而从人脸识别到视频插帧,在当时的APU产品上也都给我们留下过深刻的印象。

与其它厂商的AI PC方案相比,AMD的Ryzen AI PC拥有高达16TOPs的纯NPU算力,是目前x86架构处理器中的最高水平,并且它实现了CPU、GPU和NPU的单芯片整合设计,就代表着在有需要的时候,这些不同的单元也能进行异构计算的配合,值得一提的是,与现阶段其他家的AI PC方案相比,AMD的整套驱动、软件环境在安装难度上要低得多。

AMD在北京AI PC创新峰会上展示Ryzen AI PC生态系统的强大实力

从AMD目前的产品规划来看,无论是支持AVX512指令集的锐龙7000、8000系、线程撕裂者CPU,用于超算的CDNA加速卡,RDNA3.0架构的独显与核显,以及最新锐龙CPU内置的XDNA加速器(即NPU),它们都成为了AMD旗下产品AI算力的一部分。

苹果于 2020 年 Q4 推出 M1 神经引擎,随着 2023 年第二季度推出的 M3 系列,苹果成为了第 一家完全具备 AI 能力的 PC 制造商。

苹果作为全球消费电子产业的龙头,每次重大产品升级和创新都有望带动产业链整体的进步和投资机遇。例如,M4芯片可能会采用先进的制造工艺,如3nm甚至2nm技术,以提高性能和能效,芯片制造商台积电(TSMC)有望受益于苹果的订单。此外,供应链中的其他环节,如内存、存储和电源管理芯片供应商,也需要与苹果的新芯片设计保持兼容。对于提供AI相关服务和应用的公司来说,M4芯片的AI增强功能可能会激发新的应用场景和业务机会。

苹果AI战略曝光:简单指令iPhone搞定,复杂任务云端运行

苹果 M4 芯片发布:10 核 CPU + 10 核 GPU,2024 款 iPad Pro 首搭

同时,CES 2024 大会期间,英伟达、英特尔、AMD 再次围绕 AIPC 推出新产品。 英伟达发布了三款 GeForce RTX 40 SUPER 系列 GPU,包括 GeForce RTX 4080 SUPER、GeForce RTX 4070 Ti SUPER 和 GeForce RTX 4070 SUPER。新 GeForce RTXSUPER GPU 的专用 AI Tensor 核心可提供高达 836 个 AI TOPS,为游戏、创造和日常生产力领域的 AI 提供变革性功能。 英特尔推出全新酷睿 HX 和 U 系列 CPU,增加核显数量提高 AI 性能。酷睿 HX 系列以酷睿 i9-14900HX 为主,该处理器拥有 24 个核心,分别是 8 个性能核心(P 核心)和 16 个高效核心(E 核 心)。U 系列移动处理器以酷睿 7 处理器 150U 为主导,具有 10 核/12 线程和高达 5.4 GHz 的睿 频频率。英特尔表示,此次更新提高了 51%的多任务处理性能,支持高达 192 GB 的 DDR5-5600 兆 传输/秒 (MT/S) 内存总量,为 AI PC 提供了更强劲的解决方案。 AMD 推出 Ryzen 8000G 系列、Ryzen 5000 系列桌面处理器、Radeon RX7600 XT GPU。AMD Ryzen 8000G 系列桌面处理器,配备内置显卡 Ryzen 7 8700G 并首次将 NPU 引入台式电脑处理器。RX 7600 XT GPU 将 VRAM 从 8GB 增加到 16GB,定价 330 美元,低于英伟达最新发布的 GPU。

AIPC渗透率提升的同时,也给产业链带来了更多的想象空间。从产业链角度看,AIPC最具有投资价值、最值得关注的领域包括上游芯片制造环节和中游整机制造环节,特别是主营业务为CPU、GPU、NPU、存储等的上游芯片制造公司。

AI PC 的红利不仅仅体现在用户层面,对应用厂商来说同样具有显著的优势,能够分摊云端算力成本。将 一些处理从云端转移到终端,不仅可以减轻云基础设施的压力,同时也有助于降低运营成本。这种本地化处理 的趋势为应用开发商和应用开发者提供了更为经济和高效的方式来探索和构建应用。据估算 ChatGPT 每天的运 营成本可能超过 70 万美元。通过在 AI PC 上进行本地处理,应用厂商能够减少对云端的依赖,降低了 在维护和更新云基础设施上的投入。这对于小型独立应用开发商尤其重要,因为他们可能没有庞大的云服务预 算,AI PC 提供了一个更为可行的选择。另一方面,AI PC 的本地化大模型能力为应用开发者提供了更丰富的工 具和资源,使他们能够更加灵活地创造各种应用。这种高效性和经济性有助于激发更多独立应用的创新和发展。 应用开发者可以更容易地探索新的功能、提升用户体验,而不用过分担心云端服务的性能和成本问题。

加入微信

获取电子行业最新资讯

搜索微信公众号:EEPW

或用微信扫描左侧二维码

相关文章

-

2024-06-04

-

-

-

-

-

国际视野 2024-06-03

-

2024-05-30

-