六大科技巨头的自研AI芯片进程解读

2023 年,「生成式人工智能」无疑是科技行业最热门的术语。

OpenAI 推出的生成应用 ChatGPT 引发了市场狂热,促使各科技巨头纷纷加入竞争。

据 TechNews 报道,目前 NVIDIA 通过提供 AI 加速器占据市场主导地位,但这导致了市场上其 AI 加速器的短缺。甚至 OpenAI 也打算开发自己的芯片,以避免受到供应链紧张的限制。

在当前的 AI 发展浪潮中,NVIDIA 无疑是 AI 算力的领跑者。其 A100/H100 系列芯片已获得全球人工智能市场顶级客户的订单。

华尔街投资银行 Bernstein Research 的分析师 Stacy Rasgon 表示,使用 ChatGPT 进行的每次查询的成本约为 0.04 美元。如果 ChatGPT 查询规模扩大到 Google 搜索量的十分之一,初始部署将需要价值约 481 亿美元的 GPU 进行计算,每年需要价值约 160 亿美元的芯片来维持运营,以及类似的相关芯片执行任务的数量。

因此,无论是为了降低成本、减少对 NVIDIA 的过度依赖,甚至是进一步增强议价能力,全球科技巨头都启动了开发自己的 AI 加速器的计划。

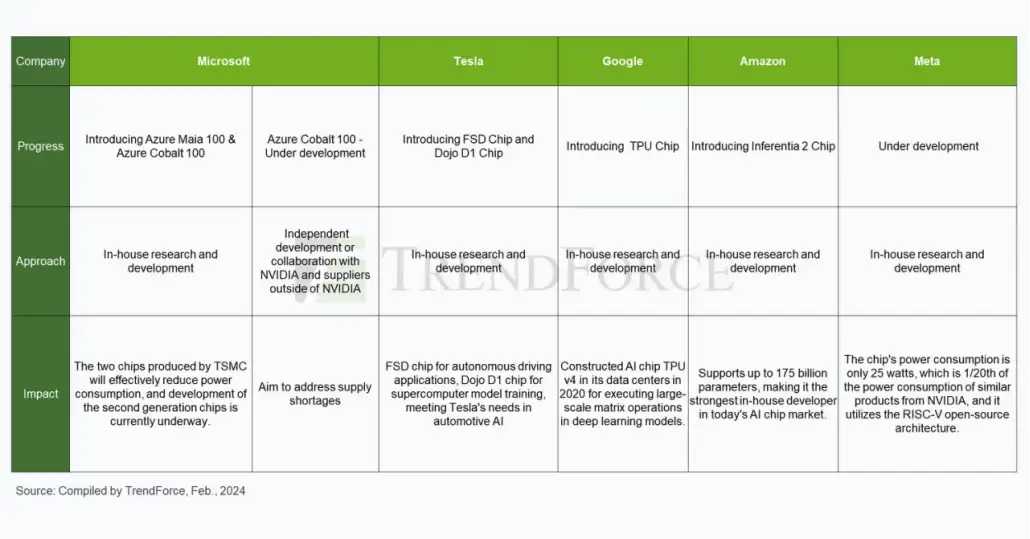

据科技媒体 The Information 援引行业消息人士报道,微软、OpenAI、特斯拉、谷歌、亚马逊和 Meta 等六大全球科技巨头都在投资开发自己的 AI 加速器芯片。这些公司预计将与 NVIDIA 的旗舰 H100 AI 加速器芯片展开竞争。

科技巨头自研芯片进展

微软

2023 年 11 月,微软在年度 IT 专业人士和开发者大会 Ignite 上推出两款自研芯片——云端 AI 芯片微软 Azure Maia 100、服务器 CPU 微软 Azure Cobalt 100。

Maia 100 是微软为微软云中大语言模型训练和推理而设计的第一款 AI 芯片,采用台积电 5nm 工艺,拥有 1050 亿颗晶体管,针对 AI 和生成式 AI 进行了优化,支持微软首次实现的低于 8 位数据类型(MX 数据类型)。微软已经在用搜索引擎 Bing 和 Office AI 产品测试该芯片。

Cobalt 100 是微软为微软云定制开发的第一款 CPU,也是微软打造的第一款完整的液冷服务器 CPU,采用 Arm Neoverse CSS 设计、128 核。

微软还定制设计了一个 AI 端到端机架,并搭配了一个「助手」液冷器,原理类似于汽车散热器。

两款芯片明年年初开始在微软数据中心推出,最初为微软的 Copilot 或 Azure OpenAI Service 等服务提供动力。微软已经在设计第二代版本的 Azure Maia AI 芯片和 Cobalt CPU 系列。

这些芯片代表了微软交付基础设施系统的最后一块拼图——从芯片、软件和服务器到机架和冷却系统的一切,微软这些系统都是由上到下设计的,可以根据内部和客户的工作负载进行优化。

OpenAI

据悉,OpenAI 也正在探索自研 AI 芯片,同时开始评估潜在收购目标。在其招聘网站上,最近也出现了 AI 硬件共同开发、评估相关岗位。OpenAI 拟筹建的合资企业与总部位于阿布扎比的 G42 和软银集团等潜在投资者进行了讨论,旨在解决当前和预期的人工智能相关芯片供应短缺问题。

毫无疑问,该项目的财务和运营规模显然是巨大的。Altman 仅与 G42 的讨论就集中在筹集 80 亿至 100 亿美元之间。该项目的全部范围和合作伙伴名单仍处于早期阶段,这表明建立此类设施网络需要大量投资和时间。

尽管还不清楚 Altman 是否计划购买一家成熟的代工厂来生产 AI 芯片,或建立一个全新的晶圆厂网络来满足 OpenAI 及其潜在合作伙伴的需求,但此前有人分析 Altman 可能会考虑把参与投资的芯片公司纳入麾下,包括 CerebrasRain NeuromorphicsAtomic SemiCerebras、Rain Neuromorphics、tomic Semi。

特斯拉

电动汽车制造商特斯拉也积极参与 AI 加速器芯片的开发。特斯拉主要围绕自动驾驶需求,迄今为止推出了两款 AI 芯片:全自动驾驶(FSD)芯片和 Dojo D1 芯片。

FSD 芯片用于特斯拉汽车的自动驾驶系统,而 Dojo D1 芯片则用于特斯拉的超级计算机。它充当通用 CPU,构建 AI 训练芯片来为 Dojo 系统提供动力。

谷歌

Google 也早在 2013 年就秘密研发专注 AI 机器学习算法芯片,并用于云计算数据中心,取代英伟达 GPU。

这款 TPU 自研芯片 2016 年公开,为深度学习模型执行大规模矩阵运算,如自然语言处理、计算机视觉和推荐系统模型。Google 其实在 2020 年的资料中心便建构 AI 芯片 TPU v4,直到 2023 年 4 月才首次公开细节。

2023 年 12 月 6 日,谷歌官宣了全新的多模态大模型 Gemini,包含了三个版本,根据谷歌的基准测试结果,其中的 Gemini Ultra 版本在许多测试中都表现出了「最先进的性能」,甚至在大部分测试中完全击败了 OpenAI 的 GPT-4。

而在 Gemini 出尽了风头的同时,谷歌还丢出了另一个重磅炸弹——全新的自研芯片 TPU v5p,它也是迄今为止功能最强大的 TPU。

根据官方提供的数据,每个 TPU v5p pod 在三维环形拓扑结构中,通过最高带宽的芯片间互联(ICI),以 4800 Gbps/chip 的速度将 8960 个芯片组合在一起,与 TPU v4 相比,TPU v5p 的 FLOPS 和高带宽内存(HBM)分别提高了 2 倍和 3 倍。

除此之外,TPU v5p 训练大型 LLM 模型的速度比上一代 TPU v4 快 2.8 倍,利用第二代 SparseCores,TPU v5p 训练嵌入密集模型的速度比 TPU v4 快 1.9 倍。TPU v5p 在每个 pod 的总可用 FLOPs 方面的可扩展性也比 TPU v4 高出 4 倍,且每秒浮点运算次数(FLOPS)增加了一倍,单个 pod 中的芯片数量也增加了一倍,大大提高了训练速度的相对性能。

亚马逊

亚马逊旗下的云计算服务提供商亚马逊网络服务(AWS),自 2013 年推出 Nitro1 芯片以来,它一直是开发自有芯片的先驱。AWS 此后开发了自研芯片的三个产品线,包括网络芯片、服务器芯片、AI 机器学习芯片。

其中,AWS 自研 AI 芯片阵容包括推理芯片 Inferentia 和训练芯片 Trainium。

此外,AWS 于 2023 年初推出了专为人工智能设计的 Inferentia 2(Inf2)。它将计算性能提高了三倍,同时将加速器总内存增加了四分之一。

它通过芯片之间直接超高速连接支持分布式推理,可处理多达 1750 亿个参数,使其成为当今 AI 芯片市场上最强大的内部制造商。

Meta

Meta 在 2022 年之前继续使用专为加速 AI 算法而定制的 CPU 和定制芯片组来执行其 AI 任务。然而,由于 CPU 在执行 AI 任务方面与 GPU 相比效率较低,Meta 放弃了 2022 年大规模推出定制设计芯片的计划,而是选择购买价值数十亿美元的 NVIDIA GPU。

尽管如此,在其他主要厂商开发内部人工智能加速器芯片的浪潮中,Meta 也涉足内部芯片开发。

2023 年 5 月 19 日,Meta 进一步公布了其人工智能训练和推理芯片项目。该芯片功耗仅为 25 瓦,是 NVIDIA 同类产品功耗的 1/20。它采用 RISC-V 开源架构。据市场报道,该芯片也将采用台积电的 7 纳米制造工艺生产。

美国去年 10 月扩大禁止向中国出售先进人工智能芯片,英伟达虽然迅速为中国市场量身订造新芯片,以符合美国出口规定。但近日有消息指出,阿里巴巴、腾讯等中国云计算大客户,并不热衷购买功能降低的减规版 H20 芯片,转成国内采购。策略转变显示透过部分先进半导体订单转给中国公司,将更依赖中国本土厂商芯片。

TrendForce 表示,中国云端业者约八成高阶 AI 芯片购自英伟达,五年内可能降至 50%~60%。若美国继续加强芯片管制,可能对英伟达中国地区销售造成额外压力。

关键词: 生成式AI

加入微信

获取电子行业最新资讯

搜索微信公众号:EEPW

或用微信扫描左侧二维码